नई दिल्ली (गणतंत्र भारत के लिए शोध डेस्क) : भारत में सोशल मीडिया प्लेटफॉर्म्स का इस्तेमाल नफरती कंटेंट से भरा पड़ा है। ऐसे कंटेंट समाज में अल्पसंख्यकों और विशेषकर मुसलमानों को निशाना बनाते हुए पोस्ट किए जाते हैं जिनसे सामाजिक वैमनस्य बढ़ता है और भाईचारे पर चोट पहुंचती है। ऐसी पोस्ट हिंदी समेत देशी भाषाओं में ज्यादा दिखाई देती हैं। दिक्कत तब और बढ़ जाती हैं जब जज्बाती किस्म की ऐसी अधिकतर पोस्टें तथ्यों को तोड़मरोड़ कर या झूठी जानकारियों पर आधारित होती हैं और एक समूह से दूसरे में फॉरवर्ड होती रहती हैं। इससे समाज के एक बड़े वर्ग की मानसिकता प्रभावित होती है। देखा ये जा रहा है कि सरकार और प्रशासन भी ऐसी नफरती पोस्टों को रोकने के लिए एक आग्रही सोच अपनाते है।

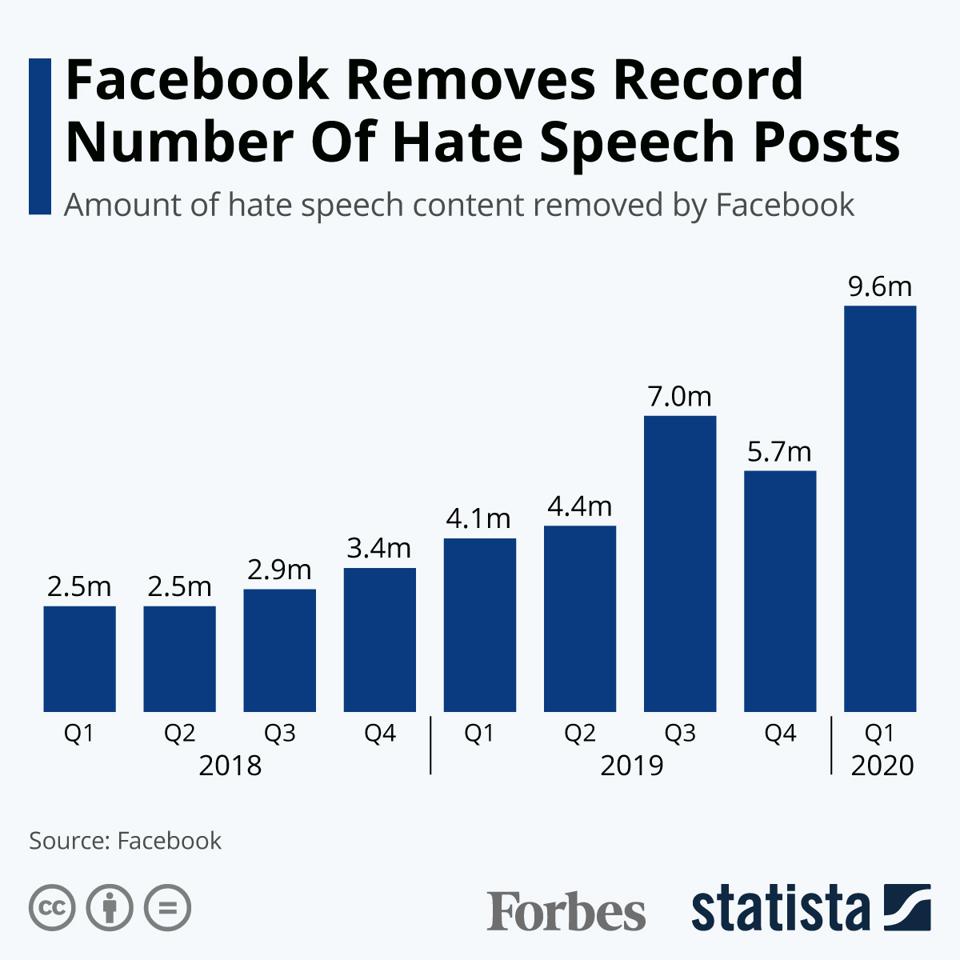

अंग्रेजी अखबार इंडियन एक्सप्रेस ने इस बारे में एक बड़ी रिपोर्ट छापी है जो सोशल मीडिया प्लेटफॉर्म फेसबुक पर हुई गतिविधियों के आंकलन पर आधारित है। रिपोर्ट के अनुसार, भारत मे फेसबुक पर नफरती कंटेंट और ध्रुवीकरण को लेकर कंपनी के स्टाफ ने 2018 से 2020 के दौरान कई बार चिंता जताई थी। स्टाफकर्मियों की चेतावनी के बाद भी फेसबुक के तत्कालीन उपाध्यक्ष क्रिस कॉक्स ने इन आपत्तियों को तवज्जो नहीं दी। 2019 की आंतरिक सुरक्षा बैठक में कहा गया कि, फेसबुक पर नफऱती कंटेंट तुलनात्मक रूप से कम है और इसमें ज्यादा दिक्कतें नहीं हैं। भारत में 2019 के लोकसभा चुनावो से पहले जनवरी फरवरी 2019 में नफरती कंटेंट को लेकर फेसबुक के सामने दो रिपोर्टे पेश की गईं। अगस्त 2020 में तीसरी रिपोर्ट आई। इस रिपोर्ट के आने के बाद औपचारिक रूप से ये स्वीकार किया गया कि फेसबुक का आर्टिफिशियल इंटेलीजेंस टूल देसी और स्थानीय़ भाषाओं में दिए गए कंटेंट की पहचान नहीं कर पाता और इसीलिए इन भाषाओं में नफऱती कंटेंट को रोक पाने में परेशानी हो रही है।

फेसबुक पर ऐसे कंटेंट के बारे में पूर्व कर्मचारी फ्रांसिस हौगन ने जानकारी साझा की हैं कि ऐसे दस्तावेजों की सिरीज अमेरिकी कांग्रेस के समक्ष प्रस्तुत की गई है। कॉक्स ने लोकसभा चुनावों से करीब एक महीने पहले भारत के निर्वाचन आयोग के साथ भी बैठक की थी।

फेसबुक की ये रिपोर्टें उसके आंतरिक मेमो का हिस्सा हैं। पहली रिपोर्ट, एडवर्सेरियल हार्मफुल नेटर्वक्सः इंडिया केस स्टडी में कहा गया कि पश्चिम बंगाल में फेसबुक पर पोस्ट किए गए कंटेंट में से 40 फीसदी फर्जी या अप्रमाणित थे। गौरतलब है कि, पश्चिम बंगाल में विधानसभा चुनाव करीब थे और वहां बीजेपी ने अपनी प्रतिष्ठा की लड़ाई लड़ने का एलान कर रखा था।

दूसरी आंतरिक रिपोर्ट टेस्ट एकाउंट के निष्कर्षों पर आधारित थी जिसे एक कर्मचारी ने फरवरी 2019 में तैयार किया था। टेस्ट एकाउंट एक डमी यूजर होता है जिसे फेसबुक का एक कर्मचारी तैयार करता है और इसकी लिस्ट में कोई फ्रेंड नहीं होता। इसे दरअसल फेसबुक के विभिन्न फीचर के प्रभाव को बेहतर तरीके से समझने के लिए तैयार किया जाता है। रिपोर्ट में बताया गया कि सिर्फ तीन हफ्तों में टेस्ट यूजर की न्यूज फीड में राष्ट्रवादी कहे जाने वाले कंटेंट, गलत सूचनाएं और हिंसा को लेकर ध्रुवीकरण करने वाली पोस्टें दिखाई देने लगीं। जबकि, टेस्ट यूजर ने सिर्फ फेसबुक के एल्गोरिथम द्वारा दिखाए गए कंटेंट ही फॉलो किए थे। रिपोर्ट के मुताबिक, इन ये बहुत ही स्तरहीन और सांप्रदायिक कंटेंट थे। अगले दो हफ्तों में विशेष रूप से पुलवामा आतंकी हमले के बाद फेसबुक के एल्गोरिदम ने ऐसे ग्रुप और पेज सजेस्ट करने शुरू कर दिए जो अधिकतर राजनीति और सैन्य सामग्री से जुड़े हुए थे।

फेसबुक उठा रहा है कदम

फेसबुक ने स्पष्ट किया है कि वो ऐसी तकनीक को विकसित करने के लिए निवेश कर रहा है जो हिंदी और बंगाली सहित विभिन्न भाषाओं में नफऱती कंटेंट का पता लगाने में कारगर होगी। फेसबुक के प्रवक्ता ने कहा है कि, हम ऐसे कंटेंट पर निगाह रख रहे हैं और हमने हेट स्पीच की संख्या को कम कर दिया। आज इसकी संख्या कम होकर 0.05 फीसदी हो गई। दुनिया भर में मुसलमानों सहित हाशिए पर मौजूद वर्गों के खिलाफ नफऱती कंटेंट के मामले बढ़ रहे हैं और इस पर लगाम लगाने के लिए हम अपनी नीतियों में फेरबदल करेंगे।

फोटो सौजन्य- सोशल मीडिया